在电影圈,有一个让所有导演和摄影师又爱又恨的词——“黄金时刻”(Golden Hour)。 那是每天日落前或日出后的短短半小时。此时的太阳角度极低,斜射的光线穿过厚厚的大气层,折射出一种温暖、柔和、梦幻的橙红色。任何画面在这个时刻的滤镜下,都会瞬间充满史诗般的诗意。 为了捕捉这半小时的“

在影视制作圈,有一句流传了数十年的“行业黑话”,同时也是所有特效师噩梦的开始—— “没事,后期再改(Fix it in post)。” 现场风太大穿帮了?后期抠掉;光线没对上?后期去调;演员表情不够到位?后期一帧帧修。长久以来,“后期”就像是一个无底深渊,默默承受着前期拍摄留下的所有烂摊

如果说,XR虚拟制片把剧组从物理世界的枷锁中解放了出来;那么,生成式AI(Generative AI)的爆发,则是给XR插上了一双通往造物主境界的翅膀。 在过去,XR制片虽然强大,但依然有一个巨大的痛点:贵且慢的“数字资产开发”。 为了在大屏幕上呈现一个高精度的3D科幻都市,原画师、3D建模师

在过去的影视工业里,有这样一个被称为“最令人羡慕”的神秘职业——勘景师(Location Scout)。 他们的工作就是公费环游世界。为了导演剧本里的一句“荒凉的异星峡谷”或“落寞的雨夜街头”,他们会背着相机,奔波于冰岛的黑沙滩、撒哈拉的腹地、或是东京的隐秘小巷。他们是剧组的“眼睛”,用脚步丈

在影视圈,有一句流传甚广的“至理名言”:伟大的艺术,往往是受罪受出来的。 为了拍出《荒野猎人》里极致的真实感,小李子(莱昂纳多)曾在零下三十度的荒原里吃生牛肝、在冰河里泅渡,差点冻掉半条命;为了拍一出大漠孤烟的戏,整个剧组要在50度的高温沙地上暴晒,中暑脱水是家常便饭。 长久以来,影视行

走进如今最前沿的影视拍摄基地,眼前的景象可能会让传统的电影人感到一丝困惑。 没有尘土飞扬的户外片场,没有堆积如山的实体道具,甚至连导演手里拿的,都不再是监视器和喇叭,而是一只游戏手柄或一台iPad。 在他们的前方,一块巨大的环形LED屏幕上,游戏软件里的3D虚拟世界正在实时运转。

在 4K/8K 广播级虚拟制片(VP)的极端工况下,技术团队在单台工作站上经常会遭遇“GPU 算力红线”。 当你在虚幻引擎 5(UE5)中开启了 Lumen、全动态光追和 Nanite,并试图渲染一个电影级复杂场景时,GPU 的使用率已经逼近 90%。 此时,如果你还要在这张 GPU 上同时运

在电视转播、大型晚会和电竞直播中,AR(增强现实)虚拟元素的出圈应用早已屡见不见。 然而,当虚拟的巨龙盘旋在真实的体育馆上空,或者虚拟的摩天大楼从真实的舞台中央拔地而起时,技术团队必然会遭遇一个关乎空间秩序的底层阵痛:“虚实空间的深度遮挡失真(Occlusion Failure)”。 最经典的

在顶级商业广告、高科技发布会和电影级虚拟制片(ICVFX)的现场,虚实融合的最高境界是“光学层面的不分彼此”。 设想一个极端的拍摄场景:一名身着高反光金属盔甲的演员,站在绿幕或 LED 容积棚中。 在三维虚拟世界里,迎面驶来一辆开启了高倍大灯的虚拟未来跑车。 此时,观众应该在最终的画面中,清晰

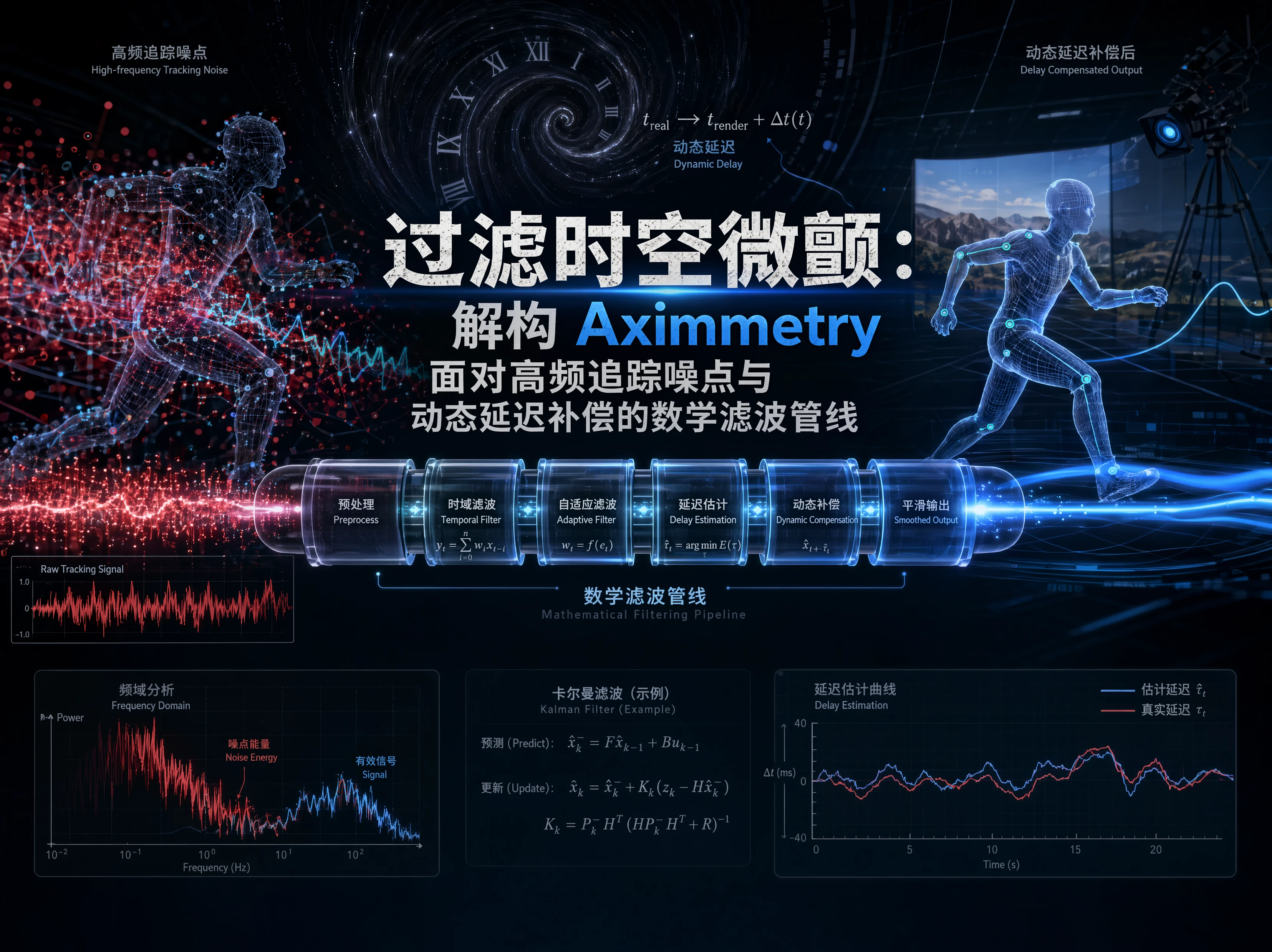

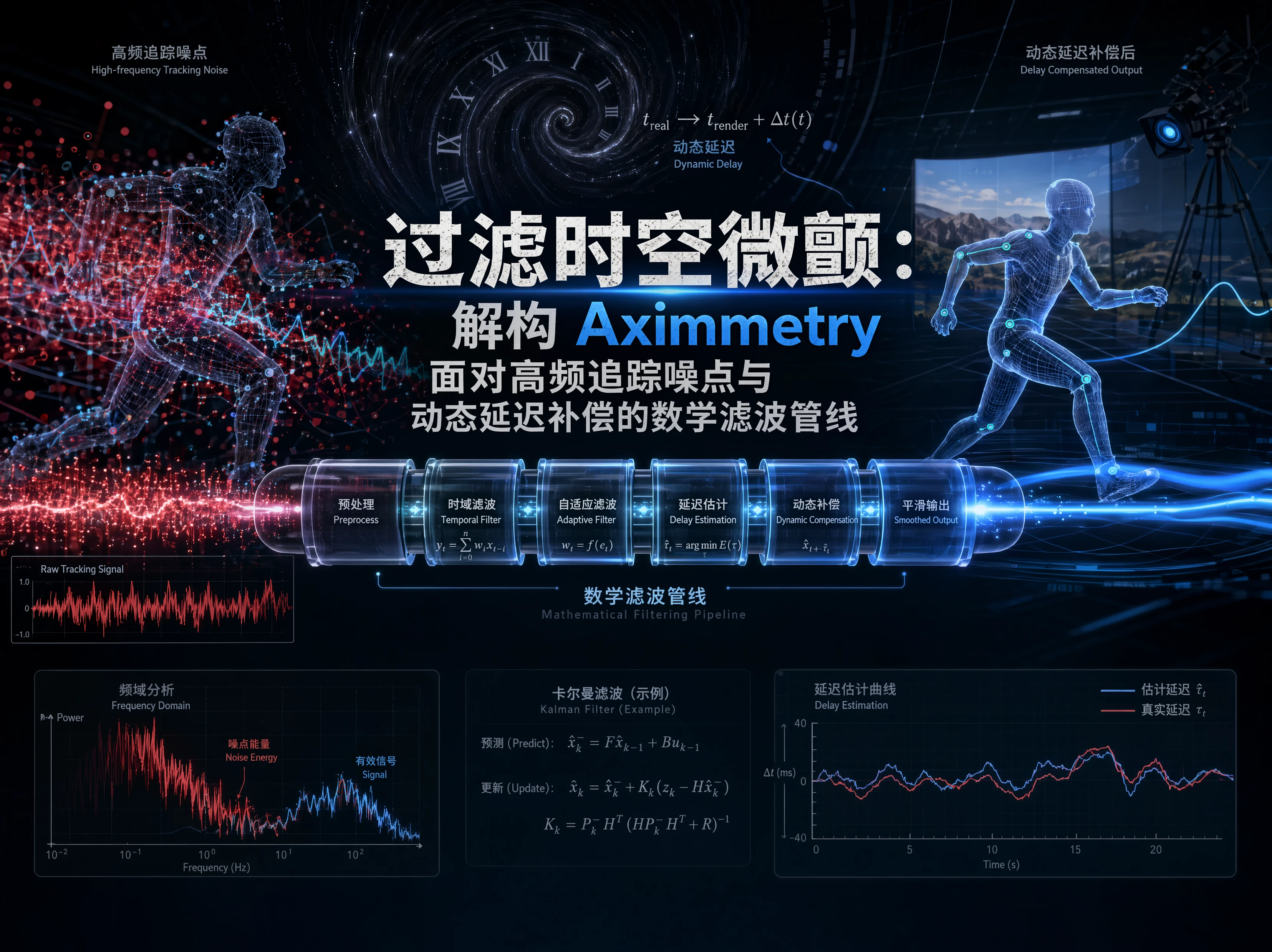

在虚拟制片(VP)与增强现实(AR)的实际执行中,技术团队最常遭遇的底层穿帮,往往不是画面的渲染精细度,而是视觉透视的微观抖动与滑移。 当摄像机静止或进行极其缓慢的推移时,大屏幕上的虚拟背景或AR元素突然发生极其微弱的、肉眼难以察觉但大脑能本能感知的“微颤(Micro-tremor)”;或者,

在虚拟制片与高级混合现实(MR)的制作中,存在一个被称为“视觉重力缺失”的普遍顽疾。 当观众看着绿幕棚里实拍的主持人站立在虚幻引擎(UE5)渲染的赛博朋克街道上时,无论背景的多边形多么精细、光追反射多么真实,画面总会隐隐流露出一股不协调的“贴片感”或“悬浮感”。 作为合成总监与光影物理学

在元宇宙交互、大型电竞盛典及未来文旅项目中,“AI 驱动的实时数字人(AI-Driven Virtual Presenter)”正迅速从概念验证(PoC)走向商业直播。 在这类场景中,观众或现场嘉宾与大屏幕上的虚拟人进行即兴、双向的语音对答。 系统需要在后台毫秒级完成以下链路: 麦克风拾音 -

在 4K/8K 广播级虚拟制片(VP)的极端工况下,技术团队在单台工作站上经常会遭遇“GPU 算力红线”。 当你在虚幻引擎 5(UE5)中开启了 Lumen、全动态光追和 Nanite,并试图渲染一个电影级复杂场景时,GPU 的使用率已经逼近 90%。 此时,如果你还要在这张 GPU 上同时运

在电视转播、大型晚会和电竞直播中,AR(增强现实)虚拟元素的出圈应用早已屡见不见。 然而,当虚拟的巨龙盘旋在真实的体育馆上空,或者虚拟的摩天大楼从真实的舞台中央拔地而起时,技术团队必然会遭遇一个关乎空间秩序的底层阵痛:“虚实空间的深度遮挡失真(Occlusion Failure)”。 最经典的

在顶级商业广告、高科技发布会和电影级虚拟制片(ICVFX)的现场,虚实融合的最高境界是“光学层面的不分彼此”。 设想一个极端的拍摄场景:一名身着高反光金属盔甲的演员,站在绿幕或 LED 容积棚中。 在三维虚拟世界里,迎面驶来一辆开启了高倍大灯的虚拟未来跑车。 此时,观众应该在最终的画面中,清晰

在虚拟制片(VP)与增强现实(AR)的实际执行中,技术团队最常遭遇的底层穿帮,往往不是画面的渲染精细度,而是视觉透视的微观抖动与滑移。 当摄像机静止或进行极其缓慢的推移时,大屏幕上的虚拟背景或AR元素突然发生极其微弱的、肉眼难以察觉但大脑能本能感知的“微颤(Micro-tremor)”;或者,

在电影圈,有一个让所有导演和摄影师又爱又恨的词——“黄金时刻”(Golden Hour)。 那是每天日落前或日出后的短短半小时。此时的太阳角度极低,斜射的光线穿过厚厚的大气层,折射出一种温暖、柔和、梦幻的橙红色。任何画面在这个时刻的滤镜下,都会瞬间充满史诗般的诗意。 为了捕捉这半小时的“

在虚拟制片与高级混合现实(MR)的制作中,存在一个被称为“视觉重力缺失”的普遍顽疾。 当观众看着绿幕棚里实拍的主持人站立在虚幻引擎(UE5)渲染的赛博朋克街道上时,无论背景的多边形多么精细、光追反射多么真实,画面总会隐隐流露出一股不协调的“贴片感”或“悬浮感”。 作为合成总监与光影物理学

在影视制作圈,有一句流传了数十年的“行业黑话”,同时也是所有特效师噩梦的开始—— “没事,后期再改(Fix it in post)。” 现场风太大穿帮了?后期抠掉;光线没对上?后期去调;演员表情不够到位?后期一帧帧修。长久以来,“后期”就像是一个无底深渊,默默承受着前期拍摄留下的所有烂摊

如果说,XR虚拟制片把剧组从物理世界的枷锁中解放了出来;那么,生成式AI(Generative AI)的爆发,则是给XR插上了一双通往造物主境界的翅膀。 在过去,XR制片虽然强大,但依然有一个巨大的痛点:贵且慢的“数字资产开发”。 为了在大屏幕上呈现一个高精度的3D科幻都市,原画师、3D建模师

在元宇宙交互、大型电竞盛典及未来文旅项目中,“AI 驱动的实时数字人(AI-Driven Virtual Presenter)”正迅速从概念验证(PoC)走向商业直播。 在这类场景中,观众或现场嘉宾与大屏幕上的虚拟人进行即兴、双向的语音对答。 系统需要在后台毫秒级完成以下链路: 麦克风拾音 -

在过去的影视工业里,有这样一个被称为“最令人羡慕”的神秘职业——勘景师(Location Scout)。 他们的工作就是公费环游世界。为了导演剧本里的一句“荒凉的异星峡谷”或“落寞的雨夜街头”,他们会背着相机,奔波于冰岛的黑沙滩、撒哈拉的腹地、或是东京的隐秘小巷。他们是剧组的“眼睛”,用脚步丈

在影视圈,有一句流传甚广的“至理名言”:伟大的艺术,往往是受罪受出来的。 为了拍出《荒野猎人》里极致的真实感,小李子(莱昂纳多)曾在零下三十度的荒原里吃生牛肝、在冰河里泅渡,差点冻掉半条命;为了拍一出大漠孤烟的戏,整个剧组要在50度的高温沙地上暴晒,中暑脱水是家常便饭。 长久以来,影视行

走进如今最前沿的影视拍摄基地,眼前的景象可能会让传统的电影人感到一丝困惑。 没有尘土飞扬的户外片场,没有堆积如山的实体道具,甚至连导演手里拿的,都不再是监视器和喇叭,而是一只游戏手柄或一台iPad。 在他们的前方,一块巨大的环形LED屏幕上,游戏软件里的3D虚拟世界正在实时运转。

你相信自己的眼睛吗? 夕阳下,主角眼角折射出的那一抹金色余晖;跑车疾驰时,金属车身上飞速流转的霓虹倒影;宇航员面罩上,那片浩瀚而深邃的旋转星云…… 在屏幕前,你被这些极度逼真的细节深深打动。但残酷的真相是:这一切都是假的。 这里没有落日,没有霓虹,更没有宇宙。这一切,不过是发生在一

如果你经常看线上直播,可能会发现一个现象: 传统的直播间正变得越来越“无聊”。主播站在一张绿幕或一块扁平的贴片背景前,声嘶力竭地喊着“全网最低价”。观众的视觉早已疲劳,停留时间越来越短,获客成本高得令人咂舌。 当“低价叫卖”的野蛮生长时代宣告结束,直播电商正迎来一场史无前例的视觉与体验革

在过去,科幻、奇幻、赛博朋克这类高视觉要求的影视题材,一直是头部大厂和天价预算的“专属游戏”。 一个小团队,如果想拍一部宇航员在火星遭遇风暴的短片,传统的路只有两条:要么花巨资搭建逼真的物理舱体;要么用绿幕拍摄,然后花半年时间、雇佣昂贵的特效团队去“死磕”后期。 其结果,往往是小团队因为

在过去三十年的影视工业里,绿幕(Green Screen)是当之无愧的“视效之王”。 从《阿凡达》到《复仇者联盟》,无数天马行空的幻想世界,都是在一间绿油油的摄影棚里,依靠后期特效师一帧一帧“抠”出来的。 然而,技术的发展无情且迅速。如今,在好莱坞和国内顶尖的制作基地,传统的绿幕正在被迅

提到XR虚拟制片,很多人脑海中浮现的第一画面是《曼达洛人》等科幻大片的拍摄现场。 但事实上,XR技术早已悄然“出圈”,在另一个更需要即时创意和视觉震撼的领域掀起了狂潮——舞台演艺与品牌盛典。 从歌手的虚拟演唱会、各大卫视的跨年晚会,到各大科技巨头炫酷的新品发布会,传统的实体舞台正在被一块

在电影和广告拍摄圈,有这样一群“追光者”。 为了拍出最唯美、最富有诗意的画面,摄影指导(DP)和导演们常常愿意付出极其疯狂的代价:凌晨3点全组集结,在寒风中等待地平线上的第一缕曙光;或者在黄昏时分,死死盯着监视器,等候那被称为“黄金时刻”(Golden Hour/Magic Hour)的、太阳

在影视和广告制作圈,一提到XR虚拟制片(Extended Reality),很多制片人和品牌方的第一反应往往是: “这技术太高端了,迪士尼拍《曼达洛人》才用得起,我们这种项目预算有限,配不上。” “LED棚一天的租金那么贵,这分明是‘烧钱’的代名词。” 这其实是行业内目前最大的认知误区。

想象一下这样的场景: 清晨,一辆最新款的智能SUV在火星赤红的荒漠上飞驰,车身反射着异星落日的余晖; 午后,一位身着高定礼服的模特漫步在1000米深的蔚蓝海底,发丝间穿过散发荧光的发光水母; 傍晚,品牌主讲人站在巨幅动态数据星河中,抬手捏合间,一款划时代的科技新品从虚拟星云中“凭空”诞生……